- Grote techbedrijven vechten tegen nieuwe regels voor het gebruik van auteursrechtelijke beschermde materialen door tools die werken op basis van artificial intelligence (AI).

- Google, Microsoft en OpenAI vinden dat gebruikers verantwoordelijk zijn wanneer AI-tools auteursrechtelijk beschermde materialen tonen.

- De techgiganten vergelijken AI-tools met kopieermachines: kun je die aansprakelijk stellen voor het schenden van auteursrechten?

- Lees ook: Wat is ethische AI eigenlijk? 2 experts bespreken wat nodig is om het vertrouwen in kunstmatige intelligentie te borgen

AI-tools zoals ChatGPT beantwoorden de vragen van gebruikers met behulp grote databases. In die databakken zitten ook auteursrechtelijk beschermde materialen. Grote techbedrijven vinden dat gebruikers van de AI-tools aansprakelijk zijn als in antwoorden van AI-tools auteursrechtelijk beschermd materiaal zichtbaar wordt.

Dit blijkt uit de kritiek die de bedrijven hebben op de plannen van de Amerikaanse Copyright Office (USCO). Deze auteursrechtenwaakhond overweegt nieuwe regels voor de manier waarop de techindustrie met auteursrechtelijke materialen moet omgaan bij het trainen van zogenoemde ‘large language models’ (LLM’s), de technologie waarop de AI-chatbots als ChatGPT werken.

De grote techbedrijven beweren dat er geen nieuwe regels voor generatieve artificial intelligence nodig zijn. Ook stellen ze dat het betalen voor auteursrechtelijk beschermde materialen hun plannen voor de ontwikkeling van AI-software in de war zou schappen

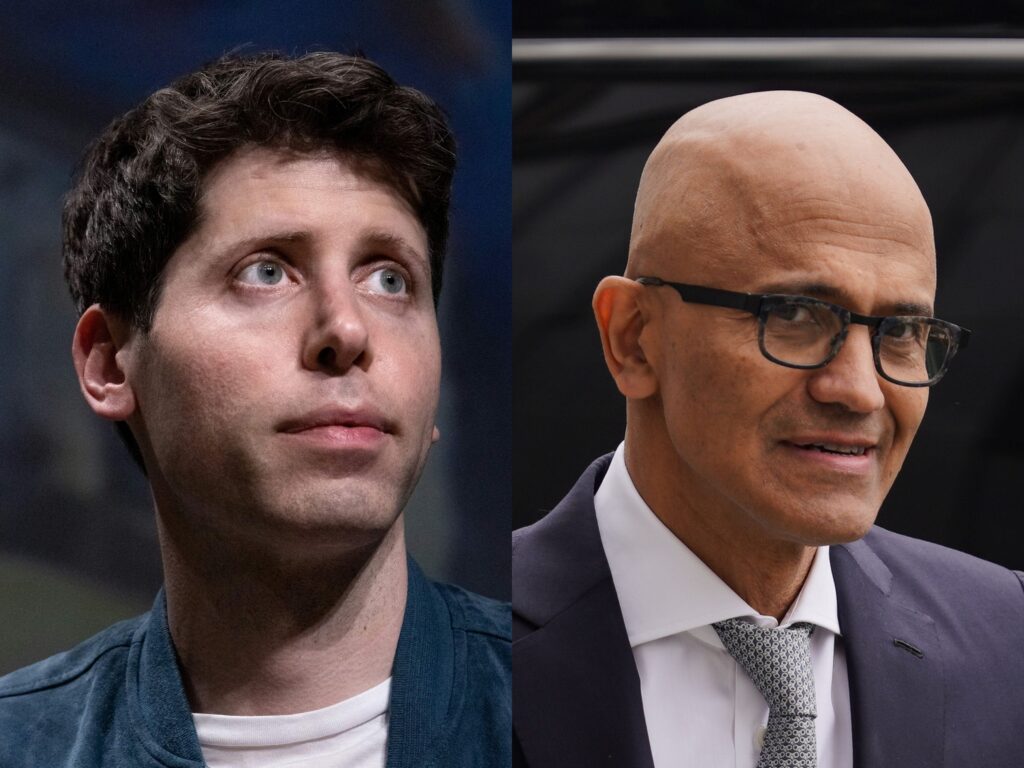

Toch ontkende geen enkele AI-ontwikkelaar het gebruik van auteursrechtelijk beschermde materialen die zomaar van het internet zijn geplukt. Ook werd er niet betwist dat de AI-tools beschermde materialen kunnen tonen. Maar als dat gebeurt, dan is de gebruiker daar verantwoordelijk voor, zeggen Google, OpenAI en Microsoft.

Google stelt dat als een AI-tool auteursrechtelijk beschermde trainingsdata dupliceert, het niet de fout is van de ontwikkelaar van de tool, die probeert om die data af te schermen. "Als een AI-tool gevraagd wordt om output te produceren die auteursrechten schendt, zou de gebruiker aansprakelijk moeten zijn", schrijft Google in haar kritiek.

Volgens de zoekgigant zou het aansprakelijk stellen van AI-bedrijven vergelijkbaar zijn met het aansprakelijk stellen van kopieermachines en audio- en videorecorders voor het schenden van auteursrechten.

Microsoft droeg ditzelfde argument aan en trok ook een vergelijking met een camera. Als je daarmee een foto maakt van een auteursrechtelijk beschermd werk, is de camera dan aansprakelijk of de gebruiker? "Gebruikers moeten hun verantwoordelijkheid nemen voor de door hen gebruikte tools", aldus Microsoft.

OpenAI schaart zich achter Microsoft, zijn belangrijkste geldschieter. "Er is geen output zonder een verzoek van een gebruiker, en de aard van de output wordt direct beïnvloed door wat er werd gevraagd."

Naarmate AI zich verder ontwikkelt, kunnen techbedrijven aansprakelijk worden gesteld

Rechtbanken hebben in het verleden doorgaans geoordeeld dat machines niet aansprakelijk gesteld kunnen worden, omdat ze niet beschikken over een "menselijk denkniveau".

Maar naarmate AI zich verder ontwikkelt, kan dat veranderen. Generatieve AI-tools kunnen in de toekomst een operationeel niveau bereiken om de ontwikkelaars ervan aansprakelijk te stellen, aldus een wetenschappelijke studie van Columbia Law Review.

Opmerkelijk is dat de grote techbedrijven hun generatieve AI-tools juist in de markt zetten als menselijk. Dit is dus precies wat de techgiganten uiteindelijk problemen zou kunnen opleveren.